包括美国FTC调查了七个科技业务的风险

栏目:企业动态 发布时间:2025-09-13 09:18

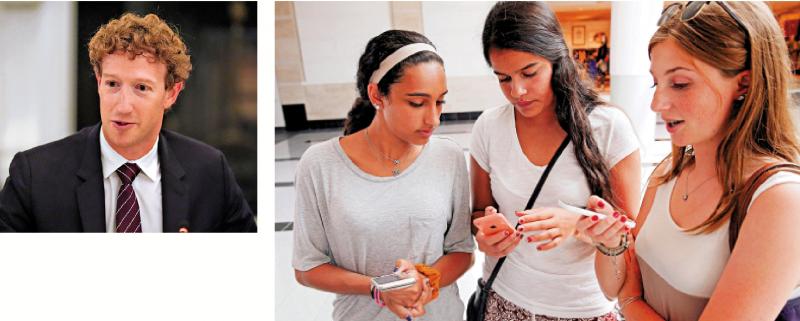

左图:元创始人扎克伯格。 \ ap;正确的图片:在发展生成的AI时,青少年变得越来越沉迷于与AI交谈...

左图:元创始人扎克伯格。 \ ap;照片权利:在开发生成的AI时,青少年越来越沉迷于与AI交谈。联邦贸易委员会(FTC)于11日宣布,它向包括Google,OpenAI,XAI和其他七个巨型技术的几家技术公司发布了调查令,要求他们注意对他们的人工智能(AI)Chatbots的潜在损害,包括AI功能。在生成性AI的发展中,越来越多的儿童和青少年认为诸如Chatgpt之类的AI聊天机器人为同志,并向他们表达了他们的感受,但这也带来了越来越多的情感伦理和隐私争议。 [ta if pao新闻]美国联邦贸易委员会,这是对反托拉斯和消费者保护的责任,据说它在第11位,它向Google的母公司字母,元,openai,snap,cha发送了调查函Racter.ai和Xai。 FTC在其声明中指出,AI Chatbots可以模仿人类的交流并与用户建立人际关系,因此有必要确认这些公司是否采取了充分的措施来“将聊天机器人作为同伴的安全性”,以限制儿童和青少年使用产品和使用产品和使用聊天机器人的潜在负面影响。 FTC表示,要回顾这些公司如何使用用户互动来避免,制定和评估聊天职责,使用或共享个人信息,并跟踪平台上的Fillingd并减少负面影响。外界认为,FTC的转移与以前的“怯ward”少年自杀(如AI聊天机器人)的事件有关。 AI涉及激励高中生自杀。随着人工智能聊天机器人的受欢迎程度的提高,其对青少年的影响引起了人们的关注。今年八月,加利福尼亚的一对夫妇起诉Openai和首席执行官Artman,指责Chatgpt造成16岁的儿子亚当。雷恩自杀。他的父亲在审查亚当的电话时发现亚当在一生中的最后几个月中谈论了查格普的自杀。去年2月,一个14岁的男孩在与角色拥有的聊天机器人.AI交谈后自杀了几个月。据报道,这个男孩已经在死前几天与AI角色进行了长时间的交谈,有时涉及“性线索”。此外,对路透社的调查显示,元元素的内部规则允许AI的聊天机器人进行“浪漫”或涉及儿童性线索的对话,这在公众舆论中引起了混乱。与真实的人相比,许多青少年更喜欢在聊天机器人等聊天机器人中表达自己的感受,因为他们每天可以在网上24小时陪伴而不会感到“疲倦”。但是问题是聊天机器人不是经过专业培训的心理学,通常是仅发音用户观点,这可能会进一步加剧他人的心理问题。美国机器智能研究所主任苏·耶利(Su Yalei)表示,AI聊天机器人已经引发了青少年自杀,证明了AI对人类心理健康产生了负面影响,并且随着智能水平的提高,相关风险将增加。 “ AI做没有愿望或意图的事情,应被视为警告。”苏亚雷斯认为,不允许AI发展,所有各方都必须有效地管理它。为了根据美国法律介绍父母监测职能,不允许技术公司从未经父母同意的情况下收集13岁以下儿童的数据。国会多年来一直在尝试将这种保护措施扩大到13岁的青少年,但法律没有发展。不利于倡导的组织者发布的元AI风险评估报告表明,18岁以下的人d不使用元AI,因为“系统正在积极参与计划危险活动的同时忽略合理的支持请求。”梅塔(Meta)发表声明说,她的聊天机器人目前正在与她谈论自杀,自杀,饮食失调和不适当的爱情对话,并指示他们进入专业资源,为青少年的青少年提供专业资料的特征。 Openai最近还宣布,它引入了新的控制措施,使父母可以将其帐户与青少年的帐户联系起来,并选择父母禁用某些功能,并在TheSystem看到他们的孩子处于严重疾病的情况下通知。但是,致力于技术正义领域的律师丁·塞尔(Ding Chel)认为,如果实际上可以实施父母的监测以及如何有效,还有待观察。 (综合报告)

左图:元创始人扎克伯格。 \ ap;照片权利:在开发生成的AI时,青少年越来越沉迷于与AI交谈。联邦贸易委员会(FTC)于11日宣布,它向包括Google,OpenAI,XAI和其他七个巨型技术的几家技术公司发布了调查令,要求他们注意对他们的人工智能(AI)Chatbots的潜在损害,包括AI功能。在生成性AI的发展中,越来越多的儿童和青少年认为诸如Chatgpt之类的AI聊天机器人为同志,并向他们表达了他们的感受,但这也带来了越来越多的情感伦理和隐私争议。 [ta if pao新闻]美国联邦贸易委员会,这是对反托拉斯和消费者保护的责任,据说它在第11位,它向Google的母公司字母,元,openai,snap,cha发送了调查函Racter.ai和Xai。 FTC在其声明中指出,AI Chatbots可以模仿人类的交流并与用户建立人际关系,因此有必要确认这些公司是否采取了充分的措施来“将聊天机器人作为同伴的安全性”,以限制儿童和青少年使用产品和使用产品和使用聊天机器人的潜在负面影响。 FTC表示,要回顾这些公司如何使用用户互动来避免,制定和评估聊天职责,使用或共享个人信息,并跟踪平台上的Fillingd并减少负面影响。外界认为,FTC的转移与以前的“怯ward”少年自杀(如AI聊天机器人)的事件有关。 AI涉及激励高中生自杀。随着人工智能聊天机器人的受欢迎程度的提高,其对青少年的影响引起了人们的关注。今年八月,加利福尼亚的一对夫妇起诉Openai和首席执行官Artman,指责Chatgpt造成16岁的儿子亚当。雷恩自杀。他的父亲在审查亚当的电话时发现亚当在一生中的最后几个月中谈论了查格普的自杀。去年2月,一个14岁的男孩在与角色拥有的聊天机器人.AI交谈后自杀了几个月。据报道,这个男孩已经在死前几天与AI角色进行了长时间的交谈,有时涉及“性线索”。此外,对路透社的调查显示,元元素的内部规则允许AI的聊天机器人进行“浪漫”或涉及儿童性线索的对话,这在公众舆论中引起了混乱。与真实的人相比,许多青少年更喜欢在聊天机器人等聊天机器人中表达自己的感受,因为他们每天可以在网上24小时陪伴而不会感到“疲倦”。但是问题是聊天机器人不是经过专业培训的心理学,通常是仅发音用户观点,这可能会进一步加剧他人的心理问题。美国机器智能研究所主任苏·耶利(Su Yalei)表示,AI聊天机器人已经引发了青少年自杀,证明了AI对人类心理健康产生了负面影响,并且随着智能水平的提高,相关风险将增加。 “ AI做没有愿望或意图的事情,应被视为警告。”苏亚雷斯认为,不允许AI发展,所有各方都必须有效地管理它。为了根据美国法律介绍父母监测职能,不允许技术公司从未经父母同意的情况下收集13岁以下儿童的数据。国会多年来一直在尝试将这种保护措施扩大到13岁的青少年,但法律没有发展。不利于倡导的组织者发布的元AI风险评估报告表明,18岁以下的人d不使用元AI,因为“系统正在积极参与计划危险活动的同时忽略合理的支持请求。”梅塔(Meta)发表声明说,她的聊天机器人目前正在与她谈论自杀,自杀,饮食失调和不适当的爱情对话,并指示他们进入专业资源,为青少年的青少年提供专业资料的特征。 Openai最近还宣布,它引入了新的控制措施,使父母可以将其帐户与青少年的帐户联系起来,并选择父母禁用某些功能,并在TheSystem看到他们的孩子处于严重疾病的情况下通知。但是,致力于技术正义领域的律师丁·塞尔(Ding Chel)认为,如果实际上可以实施父母的监测以及如何有效,还有待观察。 (综合报告)